L'ICE usa Palantir e l'intelligenza artificiale per decidere chi espellere dal Paese

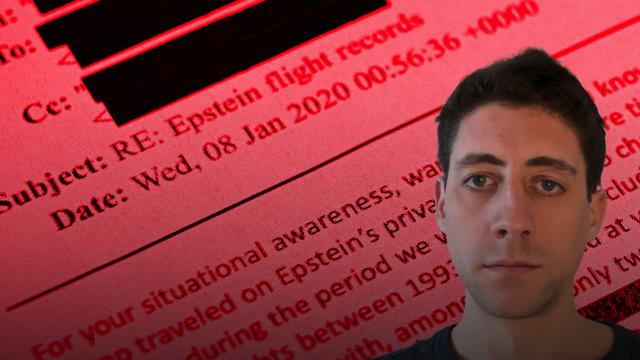

di Tommaso ProverbioNegli Stati Uniti l’ICE sta utilizzando strumenti sviluppati da Palantir per analizzare segnalazioni, incrociare database, costruire dossier e individuare obiettivi per le espulsioni.

Software che sintetizzano informazioni, generano mappe operative e trasformano dati amministrativi - perfino sanitari - in indicazioni d’azione.

Quando l’infrastruttura tecnologica diventa il cuore delle decisioni operative, il potere non è più solo nelle mani di chi governa, ma anche in chi progetta l’algoritmo.

Non è un tema lontano da noi. In Europa si sta discutendo il Digital Omnibus, una riforma sostenuta e incoraggiata dalle Big Tech che punta a “semplificare” il quadro normativo su dati e intelligenza artificiale.

Tradotto: intervenire sulla definizione di dato personale e sulle tutele dei dati biometrici previste dal GDPR.

Il rischio è chiaro. Se si allentano le garanzie per favorire l’espansione commerciale dell’IA, si riduce il potere dei cittadini sui propri dati.

E quando la protezione arretra, avanzano le logiche di profilazione, classificazione, selezione automatica.

Non si tratta solo di immigrazione o sicurezza. Si tratta del modello di società che stiamo costruendo: uno in cui i dati restano sotto il controllo delle persone o uno in cui diventano materia prima per sistemi decisionali opachi.

Il punto non è essere contro la tecnologia. Il punto è decidere chi la governa e a quali condizioni.

02:10

Software che sintetizzano informazioni, generano mappe operative e trasformano dati amministrativi - perfino sanitari - in indicazioni d’azione.

Quando l’infrastruttura tecnologica diventa il cuore delle decisioni operative, il potere non è più solo nelle mani di chi governa, ma anche in chi progetta l’algoritmo.

Non è un tema lontano da noi. In Europa si sta discutendo il Digital Omnibus, una riforma sostenuta e incoraggiata dalle Big Tech che punta a “semplificare” il quadro normativo su dati e intelligenza artificiale.

Tradotto: intervenire sulla definizione di dato personale e sulle tutele dei dati biometrici previste dal GDPR.

Il rischio è chiaro. Se si allentano le garanzie per favorire l’espansione commerciale dell’IA, si riduce il potere dei cittadini sui propri dati.

E quando la protezione arretra, avanzano le logiche di profilazione, classificazione, selezione automatica.

Non si tratta solo di immigrazione o sicurezza. Si tratta del modello di società che stiamo costruendo: uno in cui i dati restano sotto il controllo delle persone o uno in cui diventano materia prima per sistemi decisionali opachi.

Il punto non è essere contro la tecnologia. Il punto è decidere chi la governa e a quali condizioni.